La Google Search Console ha recorrido un largo camino desde sus inicios, cuando todavía se llamaba Google Webmaster Tools.

Con el creciente número de búsquedas "not provided", en mayo de 2015, Google no sólo cambió el nombre de Google Webmaster Tools a Search Console, sino que también comenzó a mostrar datos más precisos en el informe Search Analytics. Entonces fue posible desglosar los datos de búsqueda de tu sitio y filtrarlos de muchas maneras diferentes para poder analizarlos con mayor precisión.

Un par de meses más tarde, Google introdujo la API de análisis de búsqueda para permitir la integración de estos valiosos datos en dashboards y herramientas personalizadas. Unas semanas más tarde, lanzamos una herramienta completa en torno a los datos de GSC Search Analytics, llamada "Impact", ahora Ryte Search Success. Así que tenemos más de tres años de experiencia con la API de Search Analytics y más de 100.000 usuarios de Ryte ya han conectado sus cuentas de Google Search Console. Aprendimos mucho en estos tres años.

En enero, Google lanzó la nueva Google Search Console y también renovó Search Analytics, ahora el informe Search Performance. Al hacerlo, dio acceso a más datos que nunca, mostrando 16 meses de datos en lugar de sólo 90 días.

Nosotros @ Ryte somos grandes fans de los datos de Search Performance que Google proporciona dentro de la Search Console, pero todavía hay muchos SEOs que prefieren evaluar su rendimiento de búsqueda con datos de terceros, que consiste en SERPs de Google que usan scraping. No puedo entender a los SEOs que prefieren confiar en datos de terceros que en los datos reales de Google proporcionados en la Search Console.

A Google no le gustan las herramientas que hacen scraping de sus resultados. Va en contra de los términos y condiciones de Google. Últimamente, Google ha condenado las herramientas de SEO que utilizan datos con scraping de Google, incluso llegando a llamarlas "scrapers de black hat":

El popular blog de SEO Search Engine Journal también fue llamado por John para publicar una guía sobre cómo romper los términos de servicio de Google y las directrices para webmasters:

Los robots que hacen scraping en los resultados de Google son un gran problema para Google. En julio de 2016, Gary Illyes reveló en una entrevista con Woj Kwasi que ¡el 70% de todas las búsquedas proceden de bots! Esto le está costando a Google miles de millones de dólares por consultas de búsqueda que ni siquiera quieren atender.

Google siempre ha estado activo contra los webmasters que utilizan consultas automatizadas para hacer scraping de los resultados. Hay una historia divertida en el excelente libro "I'm Feeling Lucky: The Confessions of Google Employee Number 59". La historia trata sobre Ray Sidney, que solía ser "la primera línea de defensa de Google contra los webmasters que golpeaban a Google con consultas automatizadas".

"Los webmasters y SEOs querían asegurarse de que sus sitios aparecieran cerca del top de los resultados de Google, por lo que utilizaron software de monitorización para realizar búsquedas automáticas repetidas de palabras clave importantes para ellos. En períodos de gran volumen, las consultas automatizadas ralentizaban el funcionamiento de Google para todo el mundo, por lo que las consideramos una violación de nuestras condiciones de servicio. […]

Ray se tomó las consultas automatizadas no autorizadas como algo personal. Si podía averiguar la dirección de correo electrónico del remitente de spam, enviaba una breve advertencia de cese y desistimiento. Si no podía encontrar una dirección de correo electrónico, bloqueaba la dirección IP (protocolo de Internet) del remitente de spam, el número único asignado a un ordenador conectado a Internet, para que no pudiera acceder a Google. […]

Si Ray no podía identificar una dirección IP específica, se ponía en contacto con el proveedor de servicios de Internet (ISP) del remitente de spam y le pedía que rastreara al infractor por sí mismo y le cortara el acceso a Google. Si el ISP se negaba a seguirle el juego, Ray subía la apuesta - bloqueaba el acceso a Google desde todas las direcciones del ISP. Esto solía llamar su atención. Fue así como Ray cerró el acceso a Google para la mayor parte de Francia. El ISP francés definitivamente se dio cuenta."

Con miles de millones de dólares en juego, espero que Google se vuelva aún más agresivo cuando se trata de cerrar herramientas y proveedores de servicios que están haciendo scraping de los resultados de Google.

No soy el único SEO que se da cuenta de esto. En un artículo espectacular, la leyenda del SEO de la vieja escuela Glen Allsopp (también conocido por su apodo ViperChill) predice que Google pronto limitará a los proveedores de software SEO de los resultados de búsqueda de Google. Glen tiene la corazonada de que "Google empezará a tomar medidas enérgicas contra las empresas más populares que se benefician del tracking de sus resultados de búsqueda".

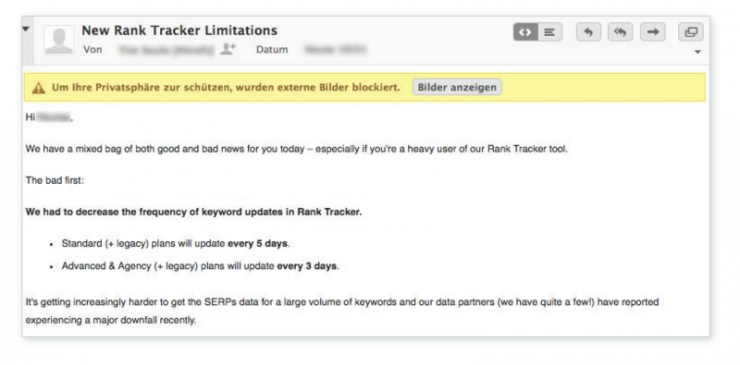

Los proveedores de herramientas de SEO ya están sintiendo a Google respirando en sus nucas. En julio, una conocida herramienta de SEO envió un correo electrónico informando a sus clientes que están disminuyendo "la frecuencia de las actualizaciones de palabras clave en Rank Tracker" porque "cada vez es más difícil obtener datos de SERPs para un gran volumen de palabras clave y nuestros socios de datos (tenemos bastantes) han informado de que han experimentado recientemente una importante caída".

Este conocido proveedor de herramientas SEO está lejos de ser el único que experimenta este fuerte viento en contra, pero definitivamente han sido los primeros en hacer esto público. Google ya ha cerrado varios proveedores de datos de scraping y continuará haciéndolo. Esto es especialmente difícil para las herramientas más baratas, ya que el coste de agregar datos de posicionamiento está aumentando exponencialmente con los proveedores de servicios que tienen que cerrar sus servicios de scraping en las SERPs.

Por supuesto, los proveedores de herramientas de SEO que dependen de los datos de scraping de Google esperan una "API SERP de Google", por lo que básicamente obtienen los resultados de búsqueda de Google a través de una API. Creo que esto nunca va a suceder, principalmente porque las SERPs son tan dinámicas hoy en día como lo son las diferentes clasificaciones y experimentos de UX que están ocurriendo en casi todas las búsquedas. En su manifiesto "Improving Search for the next 20 years", Google dice: "Sólo el año pasado, realizamos más de 200.000 experimentos que resultaron en más de 2.400 cambios en la búsqueda. La búsqueda te servirá mejor hoy que ayer, e incluso mejor mañana".

Con esta cantidad de fluctuación, sería muy difícil ofrecer "el resultado real" para una determinada consulta.

Debido al constante cambio de las SERPs, la calidad de los datos ya está bajando. Sin embargo, pocas personas se dan cuenta, ya que la mayoría no compara los resultados de su herramienta de scraping con los datos reales de Google proporcionados a través de la Search Console.

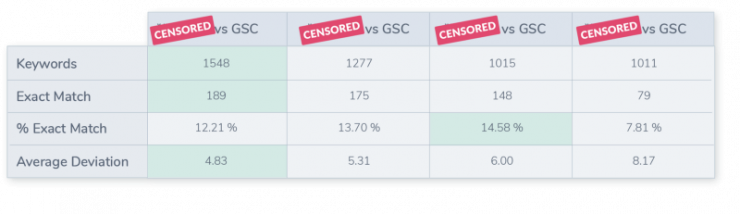

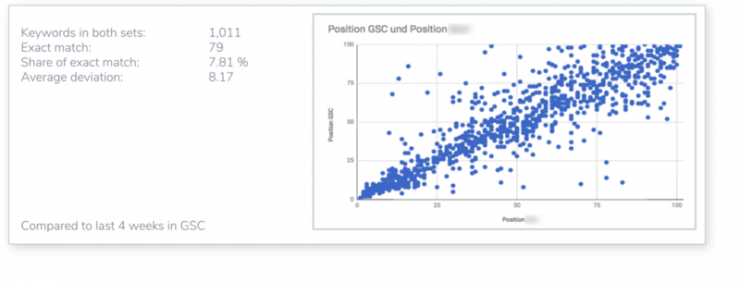

Yo comparo regularmente los datos y los resultados son decepcionantes. He aquí una comparación para uno de mis blogs de tamaño mediano:

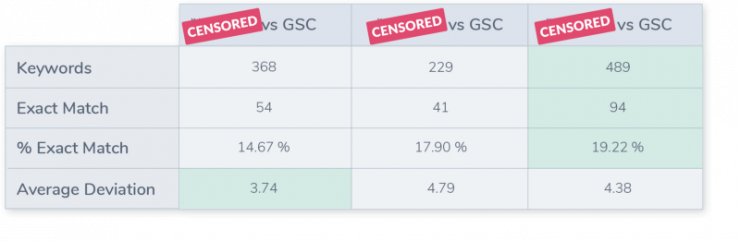

Como puedes ver, la mejor herramienta de SEO todavía sólo tiene 14,58% de coincidencias exactas con una desviación media de 6 (por lo que una posición nº2 podría ser también la posición nº8). Un resultado en la parte superior de la clasificación también podría ser el número 7 y así sucesivamente). La peor herramienta lo hace bien en menos del 8% de todas las palabras clave con una desviación media de 8,17 - lo que significa que tu serías mejor adivinando una posición de ranking.

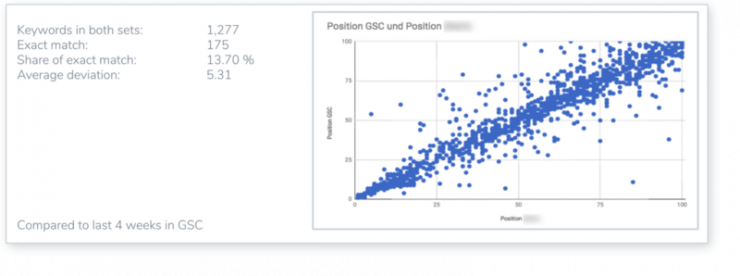

Dependiendo de la herramienta que utilices, tendrás datos que están bien:

O datos malos que parecen un poco aleatorios:

Por supuesto, los datos son cada vez más precisos cuanto más pequeño es el dominio - por ejemplo, estos datos son de un sitio de SEO centrado en las palabras clave de afiliados:

Por otro lado, cuanto más grande sea el dominio, más palabras clave tendrá, por lo que los datos serán menos precisos.

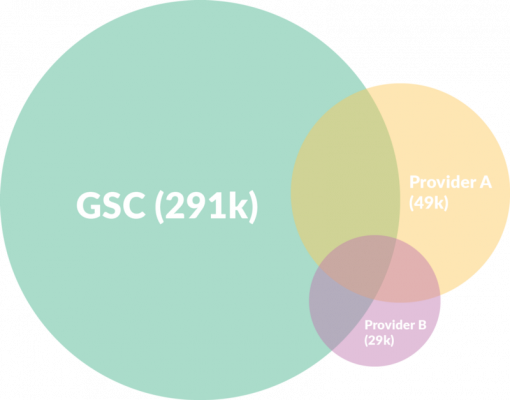

Uno de los aspectos que se tienen en cuenta en estos resultados pobres es el número de palabras clave con datos de scraping que las herramientas de SEO utilizan para sus índices de visibilidad. Hicimos un pequeño estudio con un conjunto de sitios de muestra comparando el número de palabras clave que obtienes a través de la Search Console vs. las palabras clave que las herramientas de SEO están usando, y los resultados son asombrosos:

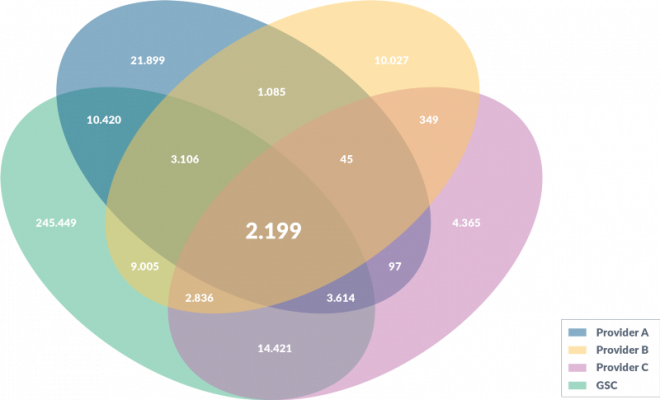

¡Con la Consola de Búsqueda es probable que obtengas al menos 5 veces, si no incluso 10 veces, la cantidad de palabras clave! Además, parece que diferentes proveedores de herramientas de SEO están haciendo scraping de mi sitio con palabras clave que ni siquiera tienen una sola impresión, por lo tanto, faltan en el conjunto de palabras clave de GSC. Así que continué comparando todos los conjuntos diferentes de palabras clave utilizados por los principales proveedores de herramientas de SEO:

De las casi 290.000 palabras clave proporcionadas por la Search Console, sólo 2.199 de ellas, es decir, sólo el 0,75% (!), son reportadas por todas las herramientas de SEO. Realmente se hace evidente que ¡estás obteniendo una imagen completamente diferente del rendimiento de búsqueda de tu sitio dependiendo de la herramienta de SEO que estés utilizando!

Si quieres realizar un análisis de la competencia comprobando las clasificaciones del dominio de un competidor, no tiene otra opción que confiar en este tipo de herramientas de SEO. Por supuesto, prefiero usar datos defectuosos que ningún dato en absoluto. Dado que todos estos defectos son válidos para todos los dominios, al menos puedo echar un vistazo al rendimiento de búsqueda de un competidor. Recientemente, Juan Gonzalez de Sistrix publicó un gran artículo sobre cómo los datos de scraping pueden ser utilizados para la investigación competitiva.

Sin embargo, si estás analizando tu propio dominio, con acceso a todos esos jugosos datos de análisis de búsqueda en la Search Console, ¡no hay una buena razón para utilizar datos de terceros!

Cómo analizar el impacto real de las Actualizaciones de Google

La Google Search Console se ha vuelto mucho mejor y más fácil de usar, pero aún nos faltan muchas cosas a las que estamos acostumbrados de las herramientas de SEO de datos de scraping. La experta en SEO Aleyda Solís escribió un gran artículo sobre “El uso de Google Data Studio para un dashboard de rendimiento de la Google Search Console más procesable" para hacer frente a las limitaciones actuales de la Google Search Console.

Si no quieres hacerlo tu mismo con Google Data Studio, también puedes utilizar Ryte Search Success, que, por ejemplo, ofrece monitorización de palabras clave basada en los datos de la Search Console. Esto significa que finalmente podrás deshacerse de la supervisión de palabras clave de terceros y comenzar a supervisar tus palabras clave más importantes con datos reales de Google.

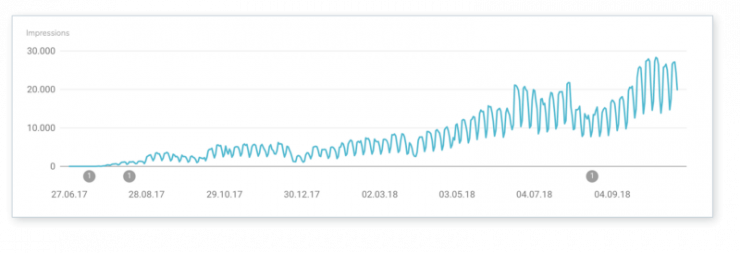

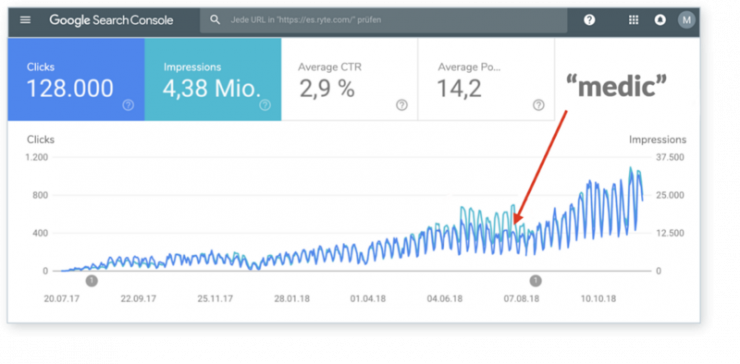

Esto es más útil cuando intentas analizar rápidamente si te ha afectado el impacto real de una actualización de Google. Este fue el caso de nuestro subdominio español, es.ryte.com. El 13 de agosto, el subdominio fue golpeado por el llamado "Medic Update":

Tengo que admitirlo, comprobar en Sistrix ese lunes en particular fue un duro golpe. Aunque no me importa nuestro índice de visibilidad, sé que muchas otras personas juzgan nuestro SEO mirando este gráfico. Así que tenía la desesperada necesidad de averiguar rápidamente lo que realmente sucedió.

Al iniciar sesión en la Search Console, puedo ver la visibilidad real en Google de nuestro subdominio en español.

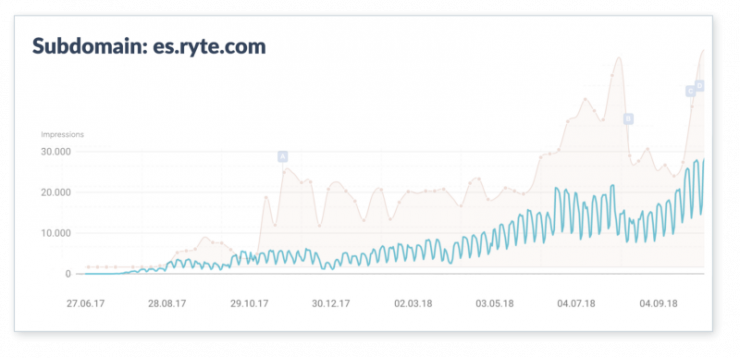

Si superpones el índice de visibilidad de Sistrix parece ser congruente con la visibilidad real de Google:

Por supuesto, la amplitud es un poco más extrema, pero ten en cuenta que Sistrix está calculando una visibilidad "general", mientras que la visibilidad real de Google se basa en el comportamiento real de búsqueda, que puede variar mucho en el día a día.

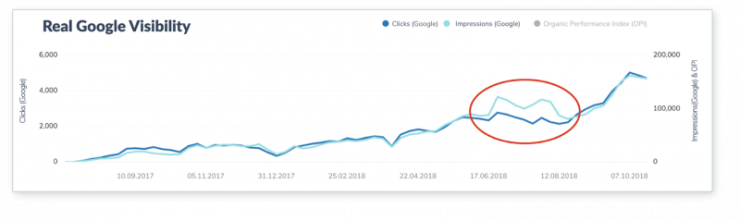

Si realmente quiero saber lo que pasó con esta actualización de Google, no tiene mucho sentido mirar sólo a la visibilidad. Es más importante ver la cantidad de clics generados. En su mayor parte, un mayor número de impresiones va de la mano con más clics ganados, pero hubo un periodo de tiempo en el que este comportamiento habitual estaba muy lejos:

Sabía exactamente dónde cavar más profundo.

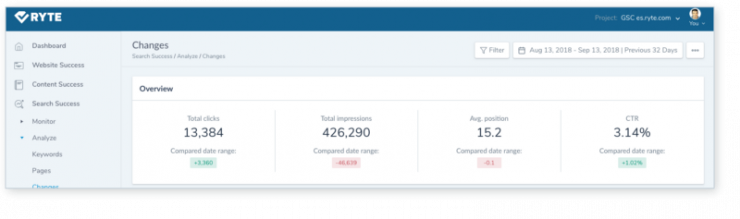

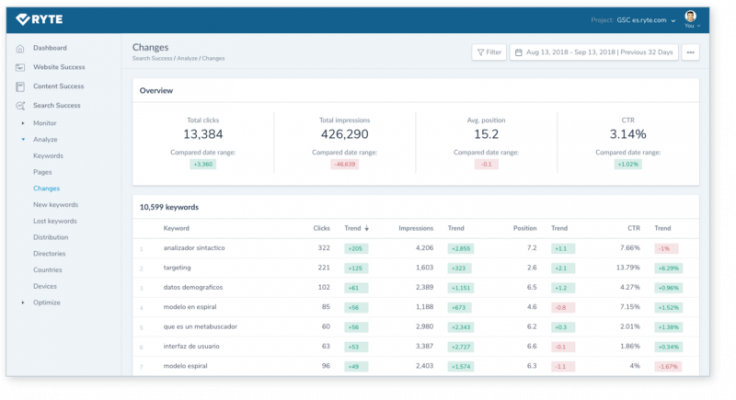

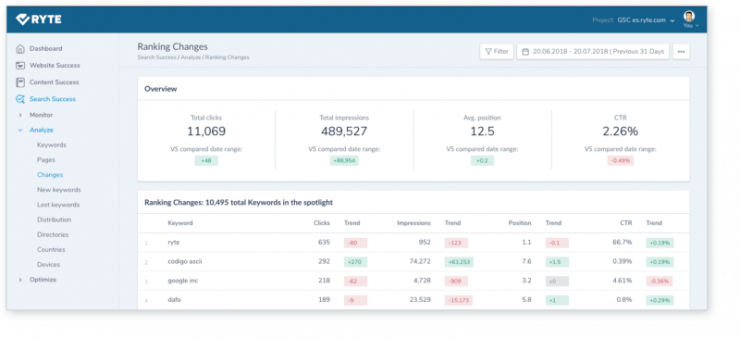

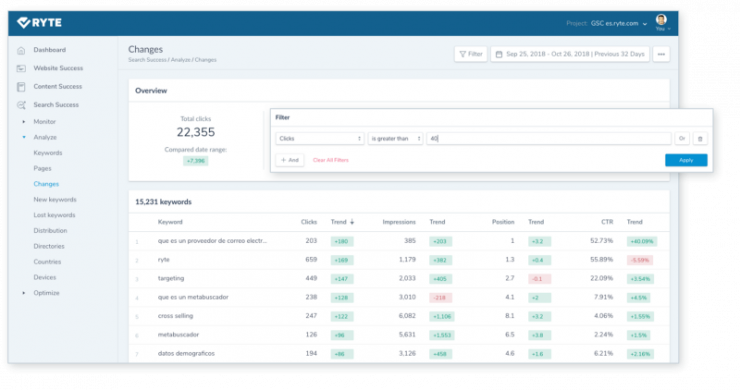

Con la ayuda del informe "Cambios" de Search Success, comparé el rendimiento de la búsqueda desde un mes antes de la actualización con el mes siguiente. Los resultados fueron asombrosos:

Sistrix tenía razón, nuestro subdominio español tuvo un gran éxito en cuanto a visibilidad, pero mientras perdimos cerca del 10% de la visibilidad, ¡ganamos un 33% más de clics en el mismo periodo de tiempo! Pienso que esto increíble y no me lo esperaba en absoluto, así que estaba dispuesto a profundizar aún más.

Ordené las columnas de clics por tendencia para encontrar todas las palabras clave que ganaron nuevos clics dentro de este periodo de tiempo:

Tomemos por ejemplo la palabra clave "targeting":

![]()

Realmente puedes ver cómo un CTR mejorado hace que una página mejore su posicionamiento.

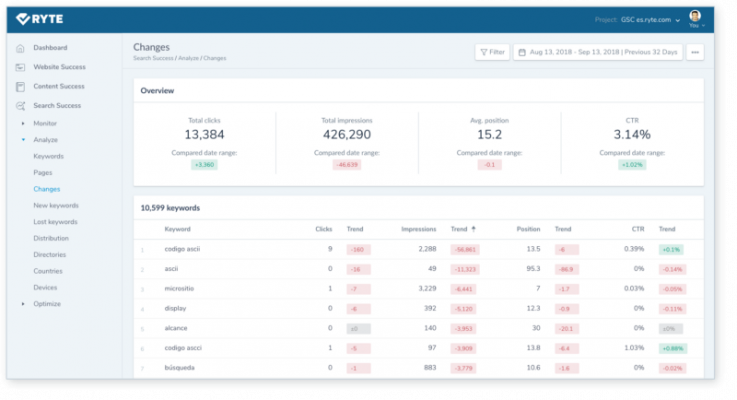

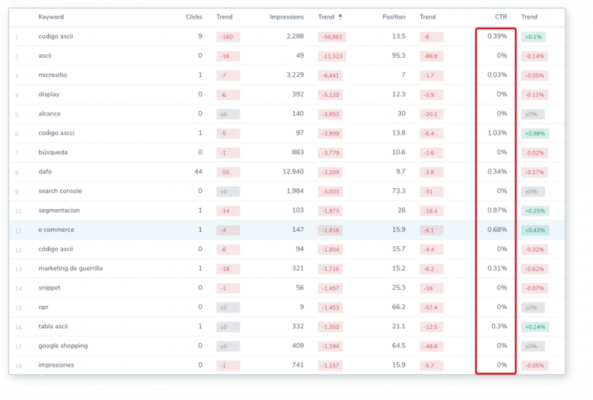

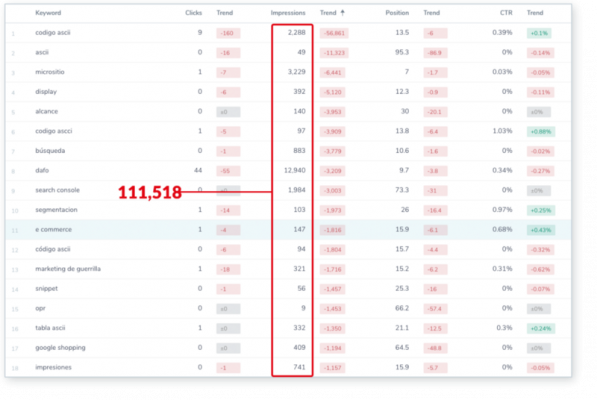

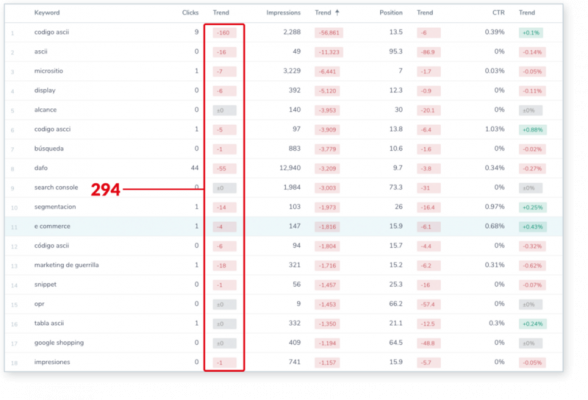

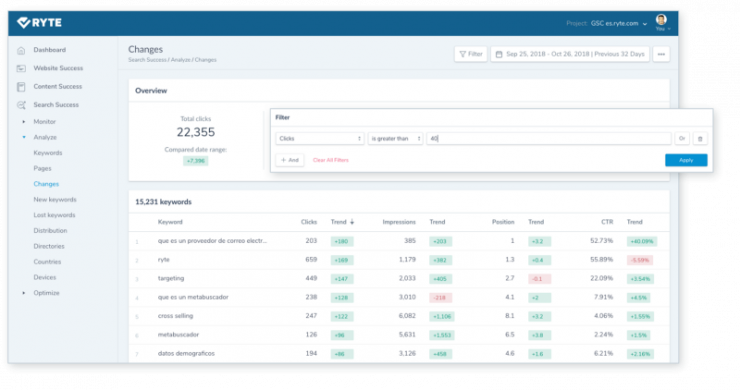

Aún así, quería saber dónde perdí la mayor parte de las impresiones y, por lo tanto, de la visibilidad, así que ordené por la tendencia negativa:

Las impresiones perdidas en nuestra página española de la wiki sobre el código Ascii fue una parte muy significativa del total de las impresiones perdidas:

Mirando las 18 palabras clave con la mayor pérdida de impresiones, se hizo evidente que sólo perdimos el posicionamiento de palabras clave en aquellas páginas en las que nadie hacía clic. Bien merecido, pero entonces,¿por qué mantendría Google una página en el top 10 cuando nadie hace clic en ella?

Las 18 palabras clave principales fueron responsables de más de 110.000 impresiones perdidas:

pero sólo 294 (!) clics (de los cuales 171 clics fueron perdidos por la página del código Ascii de la wiki):

Lo mismo ocurre con nuestro subdominio en inglés, en.ryte.com, que también se vio muy afectado por la actualización de Google Medic:

Una vez más, los únicos rankings que perdimos fueron palabras clave con CTR igual a cero.

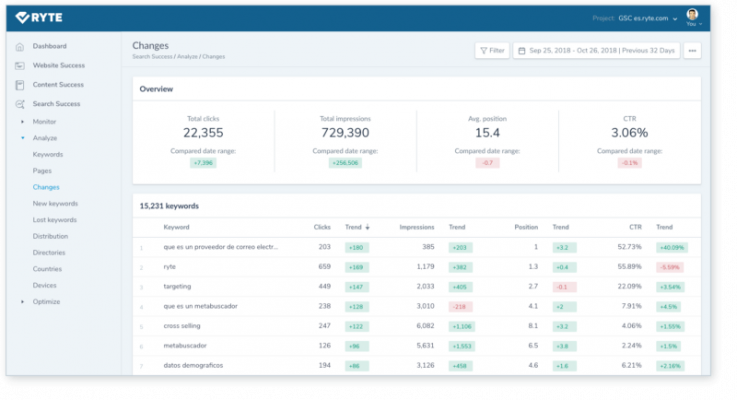

Afortunadamente, aproximadamente dos meses después, el índice de visibilidad se disparó de nuevo:

Uno podría pensar que esto podría ser un retroceso de la primera actualización de Google Medic, pero como todas las palabras clave que perdí en los rankings tenían un CTR abismal, no tendría sentido retroceder la actualización y reinstalar páginas que claramente no atraen a los usuarios a hacer clic. Utilizando el informe "Cambios" de nuevo, pude ver que las palabras clave con mayor aumento de impresiones eran totalmente diferentes de las que perdieron visibilidad durante la 1ª Medic Update.

De hecho, parece que había algo más que estaba siendo "desmantelado".

Todas esas queries sobre marcas/navegación con las que hemos estado mejorando nuestro posicionamiento desde mediados de junio. Así que Medic 1 se conectó a un incremento anterior de impresiones. Si echo un vistazo a las palabras clave que ganaron la mayor visibilidad - sorpresa sorpresa:

Siete variaciones diferentes de Código Ascii dentro de los 10 primeros resultados :)

Ahora las impresiones y los clics se ejecutan de nuevo de forma sincronizada.

Medic 2 realmente no me parece una actualización específica, es sólo el ranking de mi web mejorando con el tiempo. La fase de "impresiones altas", que terminó con Medic 1 parece haber sido una prueba, que ahora ha sido ajustada comenzando con Medic 2.

También obtuvimos un par de nuevos resultados de posición cero como este:

![]()

Con la ayuda de nuestros nuevos filtros avanzados en Search Success, puedes filtrar fácilmente las palabras clave que tienen un CTR superior al 40%, lo que, según mi experiencia, es indicativo de un nuevo resultado de posición cero:

Mientras que nuestros subdominios Ryte.com fueron golpeados con la 1ª Medic Update y se levantaron de nuevo con la 2ª Medic Update, también hay muchos dominios que mostraron exactamente el comportamiento opuesto. Por ejemplo, la revista insignia alemana para todo lo digital t3n, que es también uno de los mayores editores independientes de Alemania y un faro para el periodismo tecnológico.

Cuando llegó el primer Medic Update, t3n.de ganó mucha visibilidad, pero la visibilidad volvió a bajar con el segundo Medic Update:

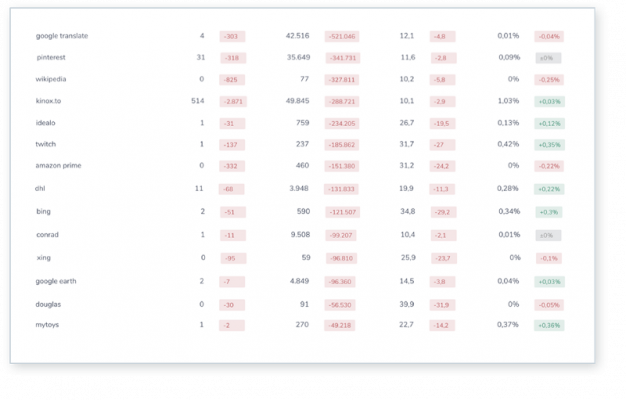

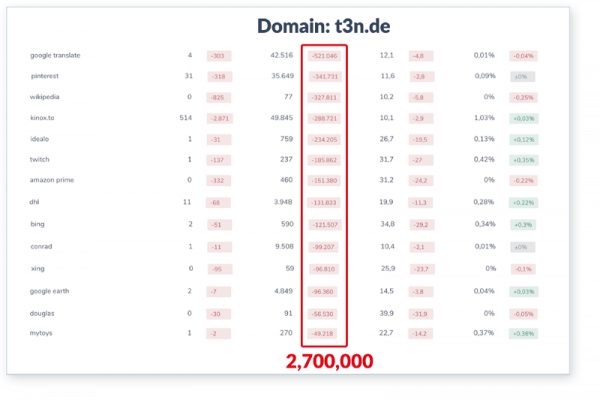

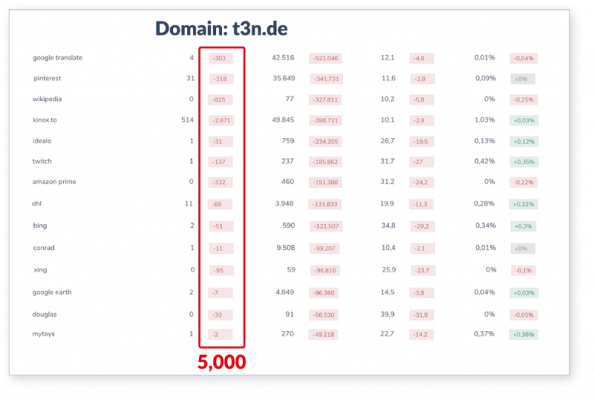

Aunque t3n.de mostraba exactamente el comportamiento opuesto, la causa de la caída de visibilidad era exactamente la misma que la de nuestros subdominios - en su mayoría eran palabras clave de marca con un CTR abismal o incluso cero:

Las 14 palabras clave que sufrieron la mayor pérdida de visibilidad representaron un total de 2.700.000 impresiones SERP perdidas:

Estas clasificaciones perdidas sólo representaron aproximadamente 5.000 clics (la mayor parte también parecía ser un artículo de noticias sobre kinox.to, que obviamente perdió impresiones cuando las noticias pasaron):

Lo que parecía una actualización y revisión importante de las SERPs fue simplemente otro ajuste de la calidad por parte de Google. Cuando no hacen clic en tu página, estás fuera del top 10.

Por supuesto, no se trata sólo del CTR - Google está buscando resultados que generen clics largos. Un clic largo es una métrica de calidad muy importante para Google, a diferencia de los clics cortos, en los que los usuarios regresan rápidamente a los resultados de búsqueda. No se trata sólo de atraer a alguien para que haga clic en tu sitio - tienes que mantener la promesa que hace con tu snippet.

Lo más importante, no te preocupes por la visibilidad. Cuanto más eficiente sea tu sitio, mejor.

Asegúrate de que las personas que hacen clic en tu páginas obtengan la mejor experiencia de usuario posible, y que su necesidad de búsqueda exacta se cumpla. Al final, esto es lo que hará que tu sitio se dispare al top de los resultados - y se quede allí.

Un buen SEO puede llevarte al top 10, pero todo lo que tienes es una única oportunidad: una oportunidad para demostrar que eres material del top 10 y que mereces una estancia permanente allí. Así que cuando tengas la oportunidad, aprovéchala. Y recuerda: don’t suck.

Escrito el 03.12.2018 por Marcus Tandler.

A Marcus le encanta el SEO. Es un orgulloso miembro de la tribu Achuar y su nombre indio "Ni Nawenak Ukutin" ("Guerrero blanco que se disparó en el pie") revela por qué ya no debe llevar armas en la selva. Marcus está contento de vivir sólo de pretzels, kaiserschmarrn y streuselkuchen durante días y días.

Optimice su sitio web con Ryte

Demo gratuita